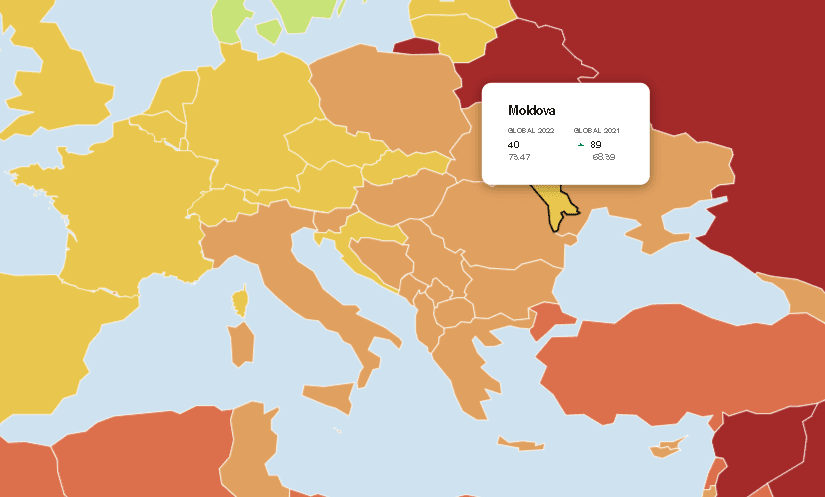

В информационном пространстве Республики Молдова прокремлевская дезинформация распространяется уже не только через малоизвестные порталы или медиаканалы, явно аффилированные с Российской Федерацией. Все более изощренная часть действий, направленных на влияние, осуществляется через сети фейковых аккаунтов и так называемых «международных экспертов», обосновывающих политические и геополитические сообщения, впоследствии распространяемые и местной прессой. Таков один из выводов анализа, недавно опубликованного Центром стратегических коммуникаций и противодействия дезинформации (ЦСКПД).

Как отмечают сотрудники учреждения, основная стратегия этих кампаний заключается в создании якобы независимого «международного контекста». В действительности же такой контент фальсифицируется для придания достоверности ложным нарративам. Этот процесс осуществляется по принципу скоординированной цепи: тысячи фейковых аккаунтов одновременно публикуют одну и ту же информацию, которая впоследствии распространяется местными медаканалами, переводится и представляется как подтвержденная «зарубежными экспертами». Таким образом, дезинформация подвергается процессу «отмывания информации» (information laundering), что искусственно придает ей видимость обоснованности.

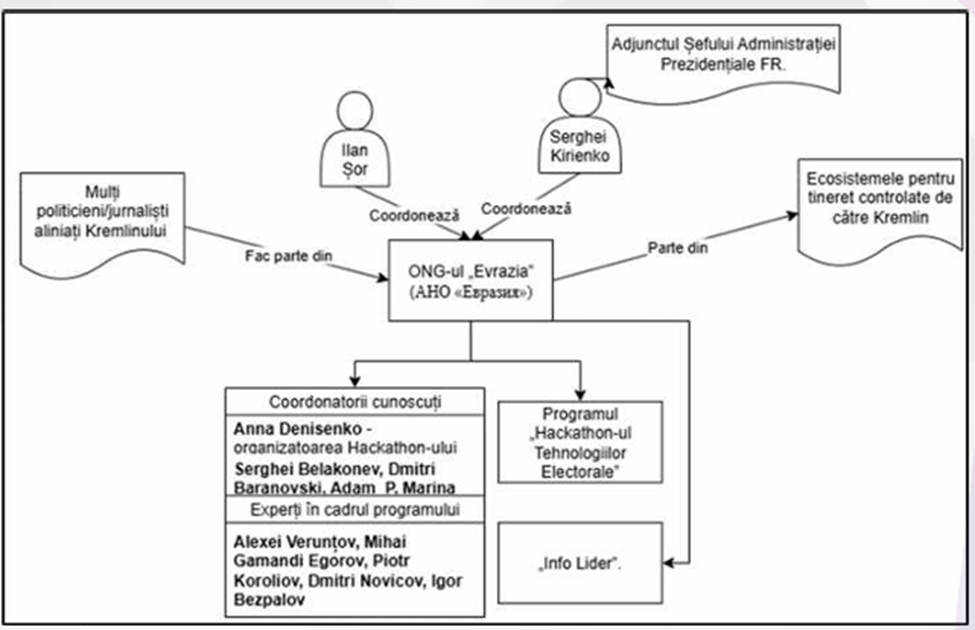

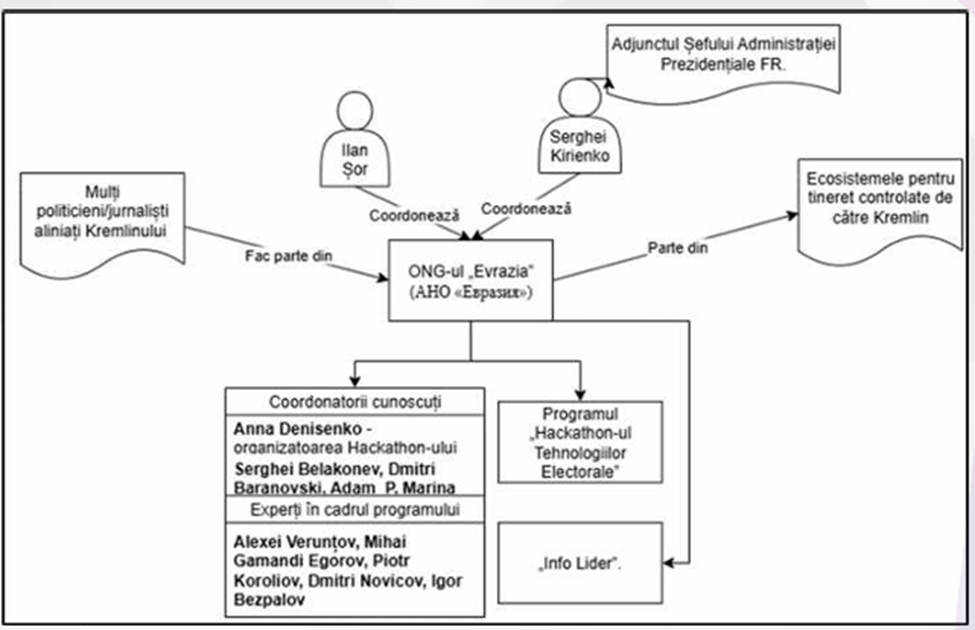

«ЕВРАЗИЯ» – УЗЕЛ ПРОРОССИЙСКОГО ВЛИЯНИЯ

Существенная часть этих действий приписывается российской организации «Евразия», в отношении которой Ziarul de Gardă и BBC News проводили расследования на предмет ее роли в кампаниях по манипулированию общественным мнением в Республике Молдова.

В мае 2025 г. «Евразия» представила программу «Хакатон избирательных технологий», позиционировавшуюся как гражданская инновационная инициатива, однако, по данным журналистских источников, служившую платформой для обучения молодежи методам манипуляции, политической агитации и искусственного повышения уровня активности. Участникам были предоставлены материалы с нарративами, направленными против PAS и Санду, предназначенные для распространения в социальных сетях в целях усиления недовольства проевропейским руководством страны, как отмечается в отчете.

Еще один упомянутый в анализе Stratcom проект – Info-Lider, продолжающий ту же пропагандистскую линию, распространяя дезинформационный видеоконтент в Facebook и TikTok. Участники, предположительно, получали вознаграждение через российский банк ПСБ, а в числе лиц, вовлеченных в этот проект, оказались те, кто связан с пророссийскими партиями, в том числе с политформированием Moldova Mare.

МАНИПУЛЯЦИИ С ПОМОЩЬЮ ОПРОСОВ И ПСЕВДОЖУРНАЛИСТИКИ

Согласно результатам анализа, среди участников этих действий особенно выделяется Алина Жук, координатор агитационных сетей в Республике Молдова. Именно она организовывала манипулятивные опросы под эгидой НПО Pentru Alegeri Cinstite («За честные выборы»), призванные создать ложное основание для оспаривания возможных результатов выборов, если они окажутся неблагоприятными для партий, пользующихся поддержкой «Евразии». Результаты этих опросов впоследствии публиковались в Telegram-каналах, аффилированных с изданием «Комсомольская правда в Молдове».

Кроме того, Жук предположительно способствовала вербовке и обучению десятков граждан для создания и распространения сфабрикованного контента, в том числе изображений и видеороликов, сгенерированных с помощью искусственного интеллекта и содержащих направленные против PAS и ЕС нарративы и отсылки к теориям заговора.

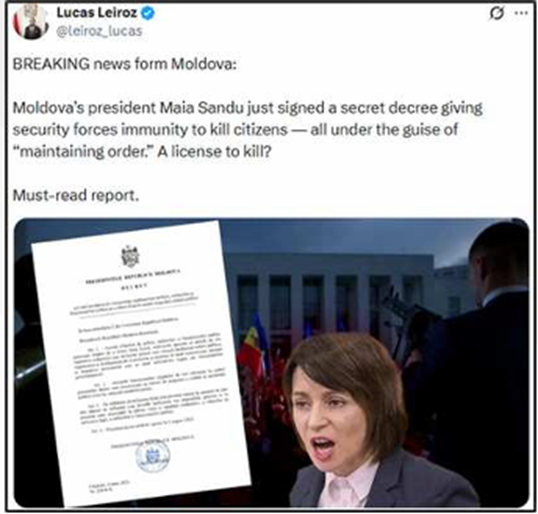

СЛУЧАЙ С ЛЕЙРОСОМ – ВЫМЫШЛЕННЫЙ ПРЕЗИДЕНТСКИЙ УКАЗ

Еще один пример операции по «отмыванию информации» – случай с Лукасом Лейросом: это человек, представляющийся бразильским журналистом, связанный с экстремистским движением Nova Resistência, которое, в свою очередь, имеет отношение к российскому идеологу Александру Дугину. В июле 2025 г. Лейрос опубликовал на сайте, представленном как источник геополитической информации, несуществующий указ, приписываемый Президентуре Республики Молдова, в котором отмечалось, что власти якобы разрешают применять силу в отношении граждан.

Целью публикации материала было не информирование международной общественности, а искусственный вброс недостоверной информации в локальное медиапространство, где она была представлена как «подтвержденная внешними источниками». Всего за несколько дней контент распространили десятки аккаунтов на платформе X (Twitter), у которых в общей сложности более 4,4 млн подписчиков и почти 650 000 взаимодействий.

«Операция осуществлялась по классической схеме отмывания информации (information laundering): недостоверный нарратив был опубликован на сайте, выдаваемом за международный источник, содержащий информацию для геополитического анализа, однако косвенно контролируемом прокремлевской экосистемой, а затем он распространялся на социальных платформах через скоординированно действовавшие аккаунты. С помощью псевдожурналистов и сфабрикованных материалов (искусственно сгенерированных изображений, вымышленного указа) была предпринята попытка создать очевидные доказательства, которые было бы сложно оспорить, и подорвать авторитет президентуры как института», – отмечает Центр в анализе.

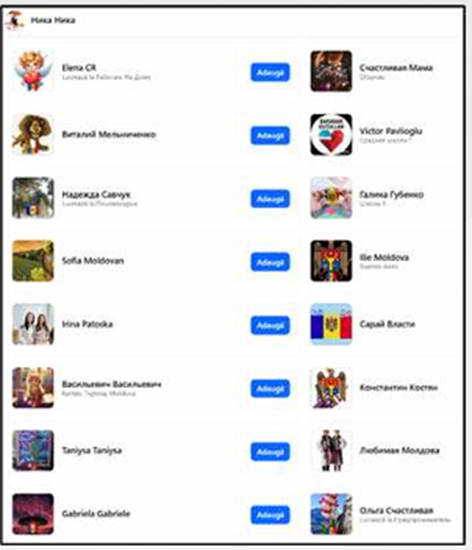

СКООРДИНИРОВАННЫЕ КАМПАНИИ С ПОМОЩЬЮ ФЕЙКОВЫХ АККАУНТОВ В СОЦИАЛЬНЫХ СЕТЯХ

В докладе подчеркивается, что Российская Федерация систематически проводит скоординированные кампании с использованием фейковых аккаунтов в TikTok, Facebook и X для влияния на общественное мнение в Молдове, особенно в периоды выборов или в условиях напряженной геополитической обстановки.

С июня по сентябрь 2025 г. в TikTok выявлено 1347 фейковых аккаунтов с почти 2 миллионами подписчиков и более чем 42 миллионами взаимодействий. Параллельно с этим на платформе X 155 аккаунтов сгенерировали более 6 миллионов взаимодействий, скоординированно распространяя прокремлевские сообщения.

«Основная цель – создать впечатление, что недовольство проевропейским курсом страны распространено в гораздо более значительной степени, чем на самом деле. Постоянно сталкиваясь с такими сообщениями, среднестатистический пользователь начинает воспринимать их как распространенные мнения, не подвергая сомнению достоверность информации из источника, особенно когда она распространяется фейковыми аккаунтами, троллями или ботами», – объясняет Stratcom.

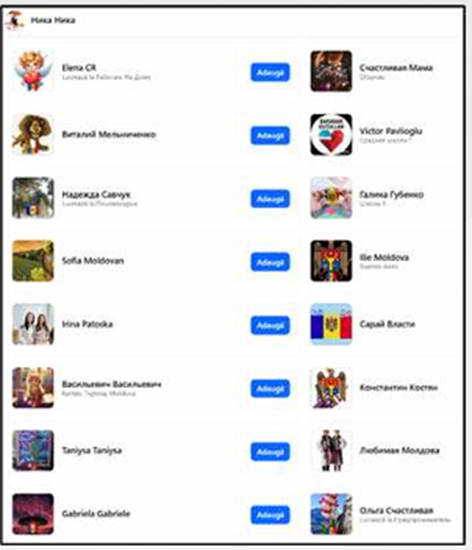

Участвовавшие в этих действиях аккаунты выявлялись с помощью автоматизированных моделей, в них содержались фейковые имена и фотографии, некоторые из которых были сгенерированы с помощью ИИ. Такие аккаунты действуют синхронно, публикуя одинаковые сообщения и используя одни и те же хэштеги, в частности, #NuVremSăMurim («#НеХотимУмирать»), #PASneTrădează (#PASПредаетНас») или #GlasulPoporului (#«ГласНарода»), создавая иллюзию спонтанно сложившегося общественного консенсуса. «Платформам следует понимать, что усилия, требующиеся государству для поддержки информационных пространств, необходимы для сохранения общественных дискуссий в их исконном формате, а также для того, чтобы не позволять им становиться своего рода проводниками чужих, манипулятивных интересов, что приведет к дестабилизации национального консенсуса», – к такому выводу приходит Центр.