Ежедневно в интернете появляются инструменты, способные имитировать человеческий голос или создавать изображения и тексты, но которые при этом не имеют ничего общего с реальностью и правдой. Все эти технические «чудеса» происходят за считанные секунды. Наряду с развитием информационных технологий и вовлечением искусственного интеллекта практически во все сферы нашей жизни, появились и новые методы распространения дезинформации.

Привет, я Ана Сырбу, и в этом выпуске подкаста CuMinte мы говорим о тенденциях в области дезинформации, которые в последнее время становятся все более популярными в онлайн-среде.

Одними из новейших инструментов, используемых в качестве метода дезинформации в интернете, являются боты. Бот — это компьютерная программа, робот, выполняющий различные задачи, которые он получает от нас, пользователей. Например, когда вы получаете варианты исправления орфографических ошибок в документе Word или в тексте, который вы вводите на мобильном, знайте, что эти варианты предлагает бот. Еще одна задача, которую выполняет бот, — это автоматический ответ, который вы получаете на страницах компаний или публичных фигур в социальных сетях, когда пишете им сообщения.

Бот может использоваться и в настоящее время используется как инструмент для распространения дезинформации в интернете. Поскольку мы программируем ответы бота, он может создавать публикации или взаимодействовать с аудиторией в социальных сетях, делясь ложной или манипулятивной информацией. Субъекты дезинформации, то есть люди, которые придумывают дезинформационные кампании, могут использовать этих ботов для генерации миллионов ложных сообщений всего за несколько секунд, что делает работу журналистов и экспертов, борющихся с этой дезинформацией, практически бесполезной.

Еще один метод дезинформации, широко используемый в социальных сетях, — это микротаргетинг. Как это работает? Этот метод заключается в накоплении как можно большего количества информации об интересах потребителей. Позже на основе этой информации генерируются персонализированные сообщения, ориентированные на целевую группу.

Поскольку платформа хранит персональные данные и информацию о вас, вы являетесь потенциальной жертвой людей и учреждений, которые стремятся манипулировать вами и дезинформировать вас. Зная подробности о том, на каком языке вы говорите, какую политическую партию поддерживаете или в какой сфере вы действуете, они поймут, как вы думаете и действуете.

Таким образом, они смогут пойти дальше и реализовать еще один прием дезинформации — распространение персонализированного контента. Что это значит? Поскольку у них есть информация о потребителях медиа, участники процесса дезинформации будут знать, как создавать сообщения таким образом, чтобы влиять на ваш процесс принятия решений, будь то голосование на выборах, участие в протесте или вступление в политическое формирование. Они будут создавать контент, адаптированный для различных групп людей, который резонирует с информацией, которую они продвигают. Через определенный период они приобретают перед вами авторитет, и когда они поделятся какой-то ложной информацией – есть риск, что вы им сразу поверите.

Чтобы придать еще больше доверия при распространении персонализированного контента, применяется еще один прием дезинформации — создание фейковых персонажей. Эти фальшивые люди на самом деле являются троллями, которые притворяются экспертами, журналистами, учеными и позиционируют себя в интернете специалистами в тех или иных темах. Таким образом, это придает достоверность ложной информации и продвигает послания политической партии, влиятельного лица или бренда. Когда в тексте появляется мнение эксперта, то в глазах читателя такое содержание становится более достоверным. Мало кто из потребителей медиаконтента будет проверять личность эксперта.

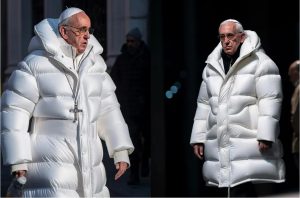

Помните сгенерированные искусственным интеллектом фотографии бывшего президента США Дональда Трампа, который якобы пытался сбежать, когда его задерживала полиция? Или изображения, на которых Папа Франциск предстает одетым в роскошную зимнюю куртку? На самом деле оба снимка были созданы синтетическими медиа, то есть искусственным интеллектом. Этот метод также относится к числу инструментов распространения дезинформации и фейков.

Синтетический медиаконтент включает в себя фотографии, видео и звуковые материалы, которые были полностью обработаны или изготовлены в цифровой среде (т. е. без прямого вмешательства человека) с целью ввести в заблуждение тех, кто их слушает или смотрит. Искусственный интеллект может сделать синтетический контент практически неотличимым от настоящего. Подобные изображения и фейковая информация используются в кампаниях по дезинформации с целью манипулирования гражданами и навязывания им определенного видения или мнения о событии или человеке.

Слышали ли вы о теориях заговора? Так или иначе, вы определенно с ними сталкивались. Многие из подобных теорий мы слышали во время пандемии Covid-19. Примером может служить ложная информация о том, что при вакцинации в наше тело вживляется чип, который впоследствии используется для контроля над нашим разумом. Теории заговора существуют с незапамятных времен и каждая новая конспирологическая история удивляет фантазией ее авторов. Теории заговора пытаются объяснить важные события как тайный сговор влиятельных лиц. Они не только влияют на понимание человеком конкретного предмета, но могут формировать все наше мировоззрение. Именно теории заговора используют дезинформаторы в качестве аргументов во время споров и дискуссий в интернете.

Относительно новое понятие — астротурфинг. Этот метод дезинформации зародился во время Холодной войны, когда его использовали для манипулирования общественным мнением. Астротурфинг направлен на создание ложного впечатления о том, что то или иное мнение пользуется общественной поддержкой. Этот метод основан на том, что вы намеренно и постоянно повторяете один и тот же месседж в социальных сетях или в прессе и придаете этой информации мнимую «популярность», которой на самом деле у нее нет. Существуют и другие формы астротурфинга – от маскировки финансовых связей политической партии с экономическим агентом, до более сложных форм, предполагающих выдумывание фиктивных лиц и личностей, которые распространяют фейки. Проверить их личность практически невозможно.

Все эти понятия легко могут сбить вас с толку, и вы, вероятно, задаетесь вопросом: какие действия нужно предпринять, чтобы не стать жертвой дезинформации и манипуляций в интернете.

Вот несколько рекомендаций, которые помогут противостоять новым инструментам дезинформации:

- Будьте осторожны с источниками информации. Facebook, Instagram и TikTok — это не источник информации, а всего лишь платформы, на которых пользователи делятся созданным ими контентом. В их числе есть и те, кто намерен вами манипулировать. Это означает, что в соцсетях вы становитесь уязвимыми для дезинформации. Так что, если вы получаете информацию с любой такой платформы, проверьте первоисточник.

- Читайте дальше заголовка. Для получения четкой информации необходимо прочитать всю статью или посмотреть репортаж целиком. Иногда необходимо почитать и другие новостные сайты или посмотреть другие телеканалы. Это позволяет взглянуть на интересующую вас тему с разных сторон.

- Когда вы видите, что друзья или члены семьи делятся в интернете фейковыми новостями или явно ошибочной информацией, поговорите с ними и посоветуйте отредактировать сообщение или вовсе удалить публикацию.

- Сообщайте о фейках. Это займет несколько секунд, но может спасти тысячи людей от манипуляций.

***

Итак, подведем итог. Для влияния и манипулирования людьми используются самые разные тактики и методы. Каждый из этих методов дезинформации призван сделать сообщения злоумышленников максимально правдоподобными и убедить общественность действовать определенным образом. Часто они стремятся поляризовать свою аудиторию, делая общественность более склонной к дезинформации.

Знание и понимание этих методов может повысить степень нашей готовности и устойчивости к дезинформации. Надеюсь, что сегодняшний выпуск сделает вас более внимательными, и если у вас есть вопросы или идеи, которые вы хотели бы, чтобы мы обсудили в подкасте cuMINTE, отправьте их на адрес электронной почты redactia@ijc.md. Фильтруйте с умом любую информацию! Слушайте наши выпуски на сайте Mediacritica.md, в Google Podcasts, Soundcloud и Youtube.

—————————————————–

Подкаст cuMINTE выпускается Центром независимой журналистики при поддержке Института по освещению войны и мира (IWPR). Мнения, изложенные в этом материале, не обязательно совпадают с мнением IWPR или его партнеров.

Слушайте подкаст

-

- Share :